米エヌビディア、推論特化GPU「Rubin CPX」を発表=超長文脈処理に対応

米半導体大手のNVIDIA(エヌビディア)は現地時間9日、長大なコンテキストを必要とするAIワークロードに特化した新型GPU(画像処理半導体)「Rubin CPX」を発表した。プログラミングや動画生成など、数百万トークン規模の大規模処理を伴う推論作業に最適化されており、既存のAI推論性能を大幅に引き上げることを狙う。

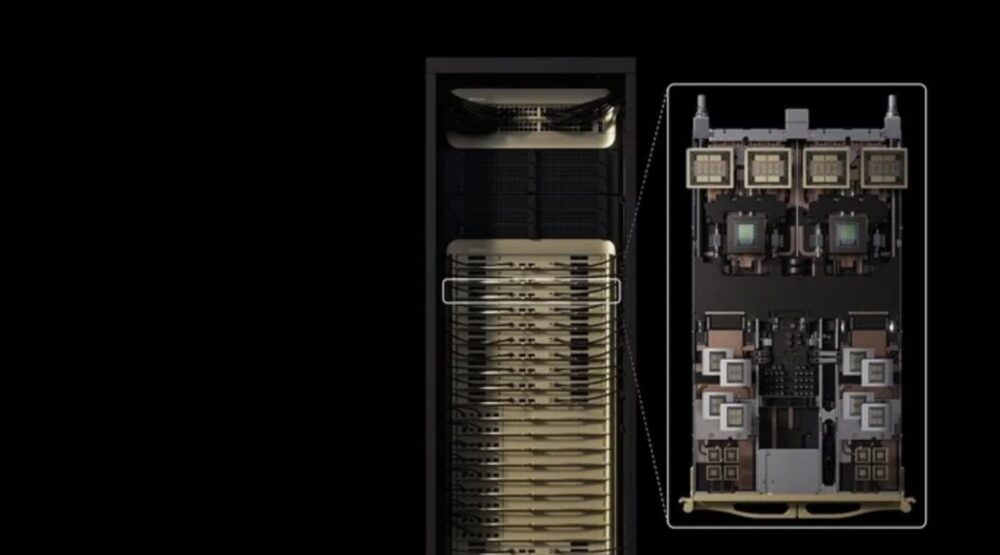

Rubin CPXは、エヌビディアが「分離式推論(disaggregated inference)」と呼ぶ新しいアーキテクチャを採用し、処理タスクを分割することで効率を飛躍的に改善。2025年のGTCで初公開された「Vera Rubinプラットフォーム」の一部として26年末に市場投入が予定されている。これは「AI(人工知能)ファクトリー」の収益性向上を目的とした新たな専用ハードウェアカテゴリーであり、汎用設計に留まる競合他社に対し、エヌビディアの優位性を一層強固にする狙いがある。

独立GPUとしてのRubin CPXは128GBのGDDR7メモリを搭載。データ関連性を見抜く「attention」処理性能は従来比で3倍に強化され、4ビット精度「NVFP4」モードを有効化すると、毎秒3000京回の演算を実現する。これにより、複雑なタスクにも高速で対応可能となる。

エヌビディアJen-Hsun Huang(ジェンスン・ファン)最高経営責任者(CEO)は「RTXがPCのグラフィックスと物理AIの表現を変えたように、Rubin CPXは数百万の知識情報を含む大規模AI文脈を処理する初のCUDA GPUだ」と強調。さらに「1億米ドル(約147億円)の投資で、50億米ドルのリターンをもたらす可能性がある」と付け加えた。

AIシステムの高度化に伴い、「バイブコーディング(Vibe Coding)」やAI補助のコード生成、動画生成といったデータ集約型タスクへの処理能力の需要は急増している。エヌビディアによれば、1時間分の動画をAIモデルで扱う際に必要なトークン数は100万を超えることもあり、従来GPUには過大な負荷となっていた。Rubin CPXは動画のデコード・エンコード・推論処理を統合し、この課題に対応する設計が施されている。

(500×80px)(450×80px)(460×80px)(470×80px)(2).png)