アリババ、生成AIモデル「Qwen3.5」をオープンソース公開

米グーグル「Gemini 3 Pro」に匹敵する性能

中国IT大手、阿里巴巴集団(アリババ・グループ)は16日、新世代大規模言語モデル(LLM)「千問(Qwen)3.5-Plus」をオープンソースとして公開した。性能は米Google(グーグル)の「Gemini 3 Pro」に匹敵するとしている。

Qwen3.5は基盤アーキテクチャを全面刷新。総パラメータ数3970億、アクティブパラメータは170億に抑えつつ、従来の1兆パラメータ級モデルQwen3-Maxを上回る性能を実現した。デプロイ時のGPU(画像処理半導体)メモリ使用量は60%削減、推論効率は大幅に向上し、最大推論スループットは最大19倍に達するという。API価格は100万トークン当たり0.8元(約17.6円)と、米グーグルの生成A Iモデル「Gemini 3 Pro」の18分の1に設定された。

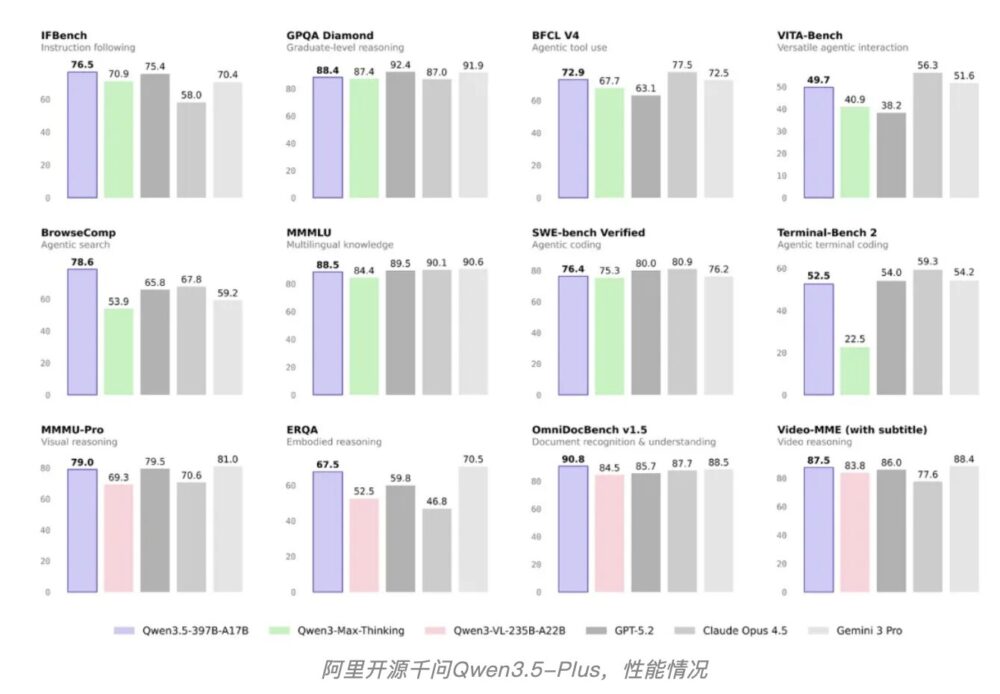

従来のテキスト特化型から脱却し、Qwen3.5はネイティブ多モーダルモデルへと世代進化した。Qwen3が純テキストで事前学習されたのに対し、Qwen3.5は視覚・テキスト混合トークンで事前学習を実施。中国語・英語・多言語、STEM、推論データを大幅に拡充し、パラメータ規模を40%未満に抑えながらもトップ性能を達成した。MMLU-Proでは87.8点で「GPT-5.2」(ChatGPT)を上回り、博士レベルの難問GPQAでは88.4点で「Claude 4.5」(Anthropic社)を超え、IFBenchでは76.5点で記録を更新。Agent系ベンチマークBFCL-V4やBrowsecompでもGemini 3 Pro、GPT-5.2を凌駕したとしている。

Transformerアーキテクチャ

性能向上の背景には、Transformerアーキテクチャへの大幅な革新があるという。さらに高性能なビジョン能力を基盤に、AgentフレームワークからAgentアプリケーションへの拡張も進展。スマートフォンやPCを自律操作し、複数アプリ横断のデータ整理や自動化処理など複雑なタスクに対応可能とした。加えて、拡張可能な非同期強化学習フレームワークを構築し、エンドツーエンドで3~5倍の高速化、プラグイン型Agentを最大100万規模まで拡張できるとしている。

2025年9月に発表された「Qwen3-Max」と比較しても、学習安定化やマルチトークン予測などの技術により同等性能を維持しつつ効率を向上。32Kコンテキストでは推論スループット8.6倍、256K超長文では最大19倍に高めた。

現在、QwenアプリおよびPC版はQwen3.5-Plusに対応済み。今後は異なるサイズ・機能のQwen3.5シリーズを順次オープンソース化し、旗艦モデルQwen3.5-Maxも近く公開予定という。

AI分野の競争激化

春節(旧正月)商戦ではAI(人工知能)分野の競争も激化している。北京字節跳動科技(バイトダンス)の動画生成モデル「Seedance 2.0」は、多モーダル入力や映画級動画生成機能で注目を集め、イーロン・マスク氏も言及。映画監督の賈樟柯氏も短編制作への活用を表明した。業界関係者は「Seedanceは現時点でSoraやGoogle Veo3.1を上回る」と評価する。

また、バイトダンスは2月14日に「Doubao-Seed-2.0」シリーズを発表。大規模本番環境向けに最適化され、IMOやICPCなど数学・プログラミング分野で世界トップ水準の成績を収めたとする。

アリババのQwen事業責任者・呉嘉氏は6日に開始した「春節30億元免単」キャンペーンでAIによる無料注文施策を展開し、初日1500万件の注文を記録したと明かした。AIを日常生活に浸透させることが目的であり、中国はAI応用で世界最前線を走るとの自信を示した。

このほか、清華大学計算機科学からスピンオフで創業された智譜AIは、新旗艦モデル「GLM-5」を公開。上海稀宇科技(MiniMax)は「MiniMax M2.5」を発表。杭州深度求索人工知能基礎技術研究(DeepSeek)も1Mコンテキスト対応の長文モデル構造をテスト中と明らかにしている。春節期間のAI競争は一段と過熱している。

(500×80px)(450×80px)(460×80px)(470×80px)(2).png)